开云盘口

开云app 我方建的数据中心, 含着泪也要联完~

没思到吧,因为数据中心“胡乱选址”,出生了一门沉着的网罗作业。

这等于DCI,Data Center Interconnect,数据中心互联,你不错以为这是大厂自建的城域/广域网,谷歌的B4网罗是这限制的祖师爷。

先为数据中心胡乱选址背锅,的确背不动了才会进行数据中心园区权略、再进行DCI网罗优化。

这种规矩在须生代、中生代、重生代的大厂里轮回,无一避免。

01 /鄙陋发育,别浪

最驱动,每个厂齐还很小,谁也不知谈能不成活到未来,更莫得专科的网工,本着少用钱的原则驱动↓

①从租一个机位驱动

②分散在不同机柜的多个机位

③需要租1通盘机柜了

④分散在多列的机柜

⑤叠加以上的轮回,模范到1整列机柜、1通盘模块包间、1整层、1整楼、1通盘园区

⑥普通不到1整层的时辰,园区就没旷地儿了,业务再增长得去别的园区租机柜了,而且请托周期独特短,否则要道业务促销没支撑好,全公司齐得歇菜

⑦这时辰普通会有配景不一的网工不到10东谈主,就会遴荐最浅易狰狞的方式(专线、裸纤齐有可能,取决于请托时效)把2个园区连起来

⑧再接下来是3个园区、4个园区…

最终就会可能造成底下这个形式,所谓的规矩就没什么规矩,也可能仅仅相宜这个城市数据中心产业的散播规矩。

02 /拓扑标准化

再往后发展,就会造成拓扑学中驰名的N²问题。

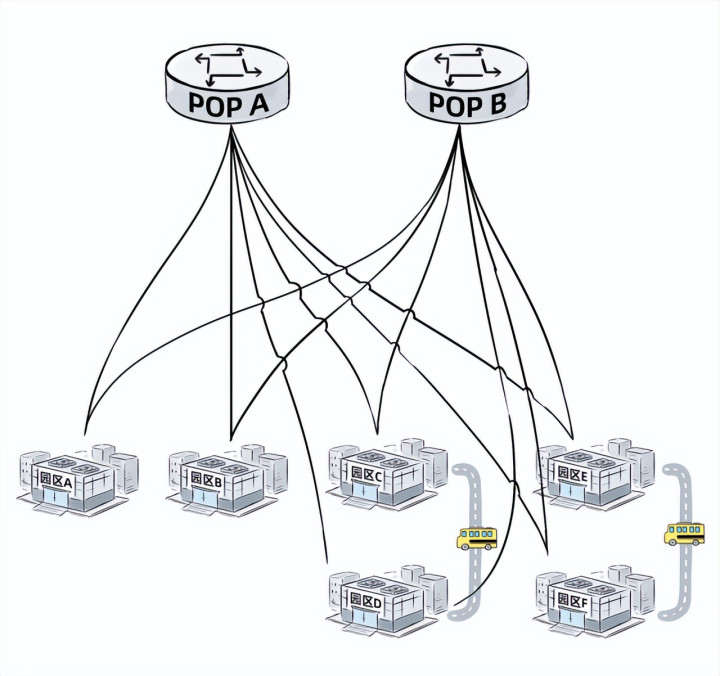

从本钱角度商酌又不可能总共是N²,是以为了避免园区太多了之后,互联太多、太乱,网工们启程点思到的是找2个POP点作为总共园区的中转互联。

总共园区齐需要和2个POP点机房互联,同期不错保留园区之间的直联,园区直联普通在这种架构中叫“纵贯车”。

{jz:field.toptypename/}

如上图,所需的连结有14条,不错若是熟谙拓扑规矩,会很了了这种Mesh组网的复杂度是O(N²)。

N暗示园区和POP点的总额,是以若是削弱N,就不错大幅缩减需要租用的互联链路。

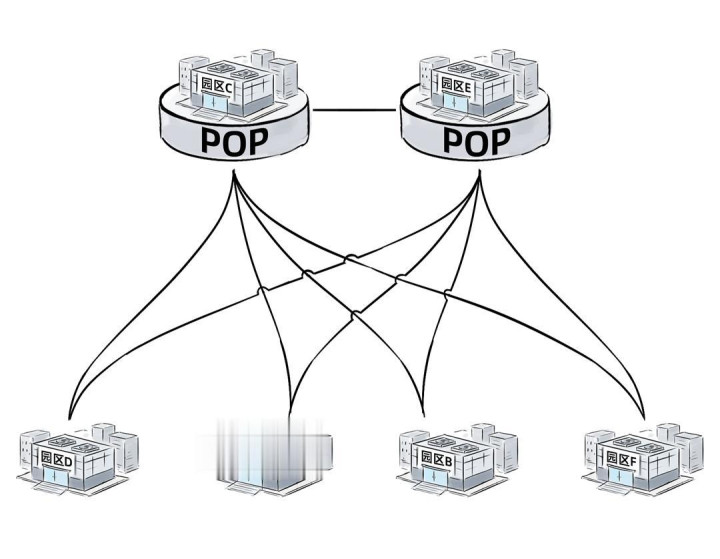

最径直的决策是,挑2个永久配合的中枢园区承担POP功能,举例下图中的C和E↓

这个决策只需要9条连结,比原决策减少了5条。

POP功能和园区合并亦然降本钱的趋势产品。

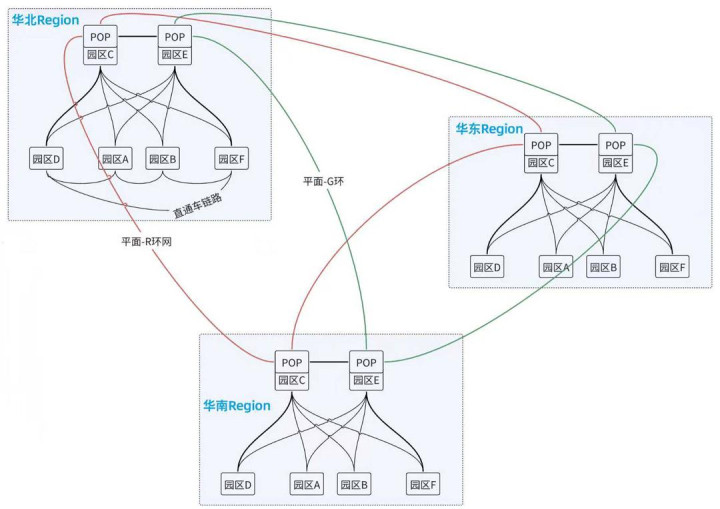

在此基础上就不错作念出跨Region互联的决策,如国内典型的华南-华东-华北三地域花式——

这基本上等于大厂遮掩世界的“红-绿”双平面环网世界性质主干网的雏形了。

在这个基础上,每个Region内园区除了和POP互联外,豪门国际官网娱乐网还不错按需组建纵贯车链路:

1、减少POP园区的办事

2、裁汰业务耦合园区之间的时延,保险业务性能

纵贯车链路的发祥主要来自于业务部署,而非网罗权略:

1、刚驱动一个新业务在犄角旮旯鄙陋发育,那里有资源就部署在那里,典型的朱元璋一只碗开局

2、这个业务鄙陋告捷了,日活爆了,但蓝本阿谁园区资源不够扩了,扩到其它园区,通过POP园区中转

3、业务跨这2个园区的redis等时延和抖动明锐的流量太大了,跨POP时延又高、又频繁被别的园区流量占用带宽,老要扩容

4、那就给这2个园区建个纵贯车链路,带宽专用、时延裁汰

03 /数通组网

❶园区内与DCN的连络

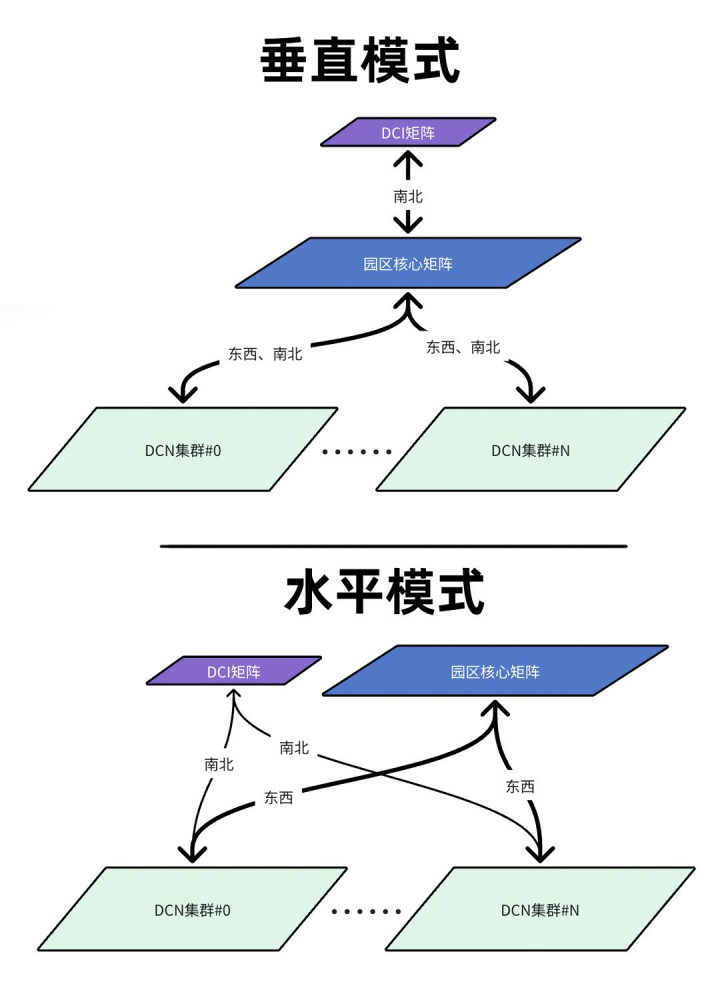

如下图,普通DCI在园区内与DCN有2种连络方式:垂直模式和平行模式。

垂直模式比较好清醒,DCI建立在拓扑上位于园区中枢的上一层,条目DCI建立与园区中枢Full-Mesh连结。

平行模式中,DCI建立和园区中枢属于消灭层级,也不错以为是一部分特殊的园区中枢。

DCI建立与园区中枢不互联,DCI建立特意用于跨园区互联,园区中枢专用于集群间的高带宽互联。

这两千般模式有各自的优缺陷,稳当不同的运营模式,开云app若是莫得什么独特的诉求。

一般的网罗团队齐会弃取垂直模式,比较好清醒,运营也容易适合。

若是有如下紧密化运营的需求,那么水平模式就会被商酌:

1、截止初建本钱,不思一次性把园区中枢和DCI矩阵全建满,而是笔据本色水位扩容矩阵中的平面

2、精确容量运营,平行方式不错精确划分南北向流量和东西向流量的水位,以兑现精确流量扩容,而避免洪流漫灌

3、减少层级,削弱几us的转发时延,不外和DCI传输距离(每10公里增多100us RTT时延)而言,这点减少微不及谈

普通独一到了极致追求本钱的情况(具备把本钱上风滚动为市集上风的智力)下,才会商酌这样顶点的操作。

雷同的,也必须具备这种极致的网罗运营智力。

❷跨园区的条约弃取

Region内,由于连结是由业务需求滚动,相对DCN没什么规矩。

因此齐无间为互联网当先的形式,那就把每个园区行为一个组织↓

1、园区和园区之间通过EBGP方式相互交换路由

2、经由POP园区或别的园区的旅途就独特于通过别的组织中转路由

这样的平允,不错自然哄骗EBGP狂放的路由战略截止互访的主用旅途和信托性备用旅途。

在跨Region场景,这时就会学习运营商的主干网想象:SIS+带RR的IBGP再叠加各式SDN夹杂的流量工程。

这样干的筹算是↓

1、主干网作为一个举座提供的是调理的跨域数据带宽服务,是以不错视为1个IBGP域

2、由于拓扑的复杂性,ISIS比较OSPF具有更简化的LSDB数据结构、自然的双栈智力不错具备更好的复杂拓扑适合性,浅易来说OSPF在ISIS眼前更像是个玩物,根柢上不了严肃运营场景的台面

3、通过流量工程不错对不同DSCP值的流量进行生动的水位截止。

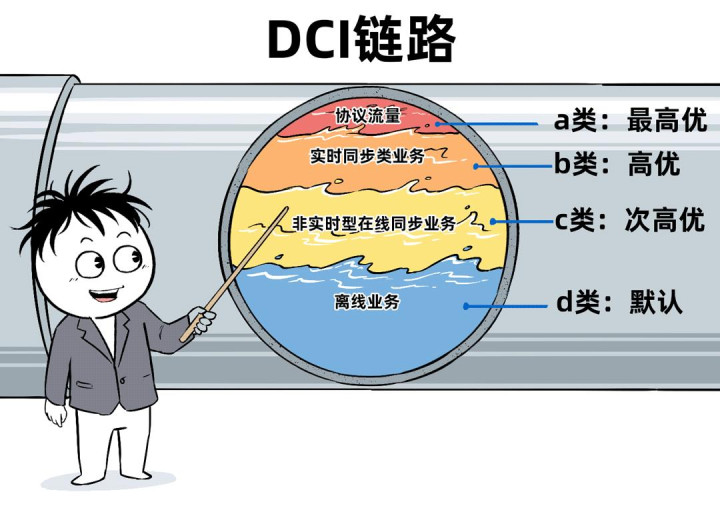

a类普通不给业务使用,是以水位截止主要在b类型流量上,阈值会截止在流露带宽的40%,打破40%就需要商酌扩容了。

剩下的60%带宽其中大部分会给c类流量作为quota,闲置带宽就不错被d类流量嘱托使用。

不同类型流量的收费战略不错用天壤之隔来描述,否则总共业务就齐会说我方独特遑急得用b类,这种收费服务模子会倒逼业务划分流量,避免预算糜掷。

a.条约流量最高优先级,占比极低

b.业务流量高优,确保SPF+应承带宽转发(拥塞场景中,也优先保险转发)普通给及时同步类业务

c. 业务流量次高优,应承带宽转发(不确保SPF,拥塞场景中会被绕行),普通给非及时在线同步业务

d.业务流量默许,不应承带宽转发(在拥塞场景中,会被优先丢弃),普通给离线类型业务

这种战略不错让网罗团队充分晋升直快的主干带宽哄骗率,在上司勾通那里得回连绵无间的点赞。

具体流量工程的方式就未几先容了,等于老一辈的MPLS TE、中生代SR-TE、重生代SRv6,况且加上SDN作援救全局逶迤。

评价方式已经看能不成在保险要道业务b类流量的前提下充分让c、d类流量提高链路带宽哄骗率。

这齐是被Google B4 90%以上哄骗率卷起来的游戏。

❸一个常被疏远的要道点:踏实性

前边说的这好那好齐是一切齐正常的情况下,DCI非论是城域已经主干齐依赖光传输OTN网罗。

光传输的SLA是50ms保护,50ms对许多明锐的内存数据库应用来说是一定会有感知的。

同期DCI建立数通条约互联会经由许多2层和1层建立,无法在条约层快速感知到中间链路的很是。

这就需要在每条物理链路上叠加BFD,以兑现快速探伤端到端很是,而传统的BFD办事在3层,无法遍历每一条物理链路,这就需要进行相应的条约校正。

由于探伤的智谋性取决于探伤频率,高频BFD会严重占用主控CPU资源,端口一多就更让CPU吃不用,是以硬件级BFD齐是DCI的低支拨特质。

许多时辰,我看到以太网表层垒这样多复杂的特质,就忍不住要发点感触↓

为啥以太网的链路层条约在HPN里啥齐能改,可到了DCI场景,不成加个像SDH网罗那样具备物理层连结可靠性的探伤条约呢?

那就不需要什么BFD了,芯片厂商径直把这部分钱给赚了。

好了,对于DCI就聊这样多吧,祝大家拉纤惬心,搬砖丝滑。

备案号:

备案号: